Тотальный контроль? Большой Брат хочет следить за твоими эмоциями

Тотальный контроль? Большой Брат хочет следить за твоими эмоциями

Илон Маск боится искусственного интеллекта, который может захватить контроль над человечеством. «Разрабатывая ИИ, мы призываем демонов», — заявил миллиардер лет семь назад. И Стивен Хокинг предупреждал об опасностях, которые таит в себе искин: если оставить его без должного внимания, цифровой разум может оказаться слишком опасным. По мнению Хокинга, в краткосрочной перспективе проблемой является то, кто именно контролирует ИИ, в долгосрочной — можно ли его контролировать в принципе.

Немного пофантазируем, но в привязке к реальности и существующим технологиям. Когда-нибудь «настоящий» ИИ, самостоятельный и способный принимать серьезные решения без участия человека, появится. Наверняка ему разрешат управлять важными системами и, например, следить за порядком: теоретически он беспристрастен (здесь снова можно вспомнить слова Хокинга). А безопасность — одна из основ стабильного, управляемого и процветающего общества.

Обеспечить должный уровень безопасности можно разными способами, в том числе контролем. Этот путь выбирают многие, поэтому появляется все больше сетей интеллектуального видеонаблюдения, его постепенно «обвешивают» новыми функциями. Сейчас в тренде алгоритмы распознавания эмоций — непростых психических процессов, которые могут рассказать о человеке многое.

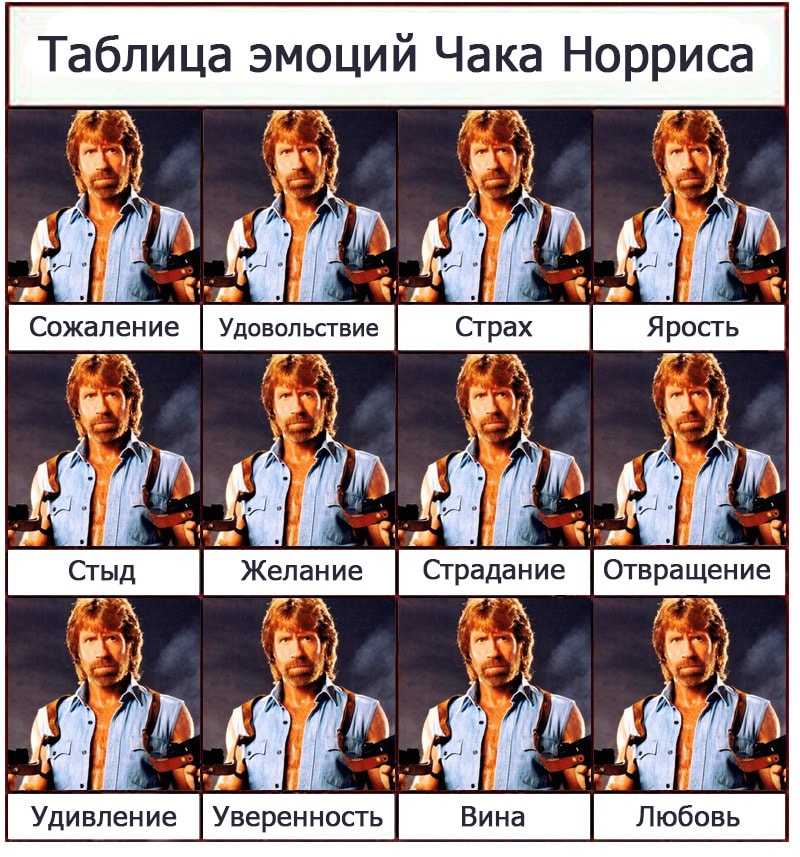

Загвоздка в том, что прочитать эмоцию часто сложно, а иногда — невозможно. Особенно если вы не дока в этом деле. Плюс к тому она может быть привязана к определенным условиям и событиям. Не будем углубляться в определения терминов (есть эмоция, реакция, переживание, настроение и так далее), подойдем к феномену с точки зрения научпопа.

Если человек разгневан, он опасен? Чем вызван гнев и на кого направлен? Может, это обида на кота, который снова пожевал любимый цветок. Или на себя за неправильно забитый в стену гвоздь? Реакция на критику? Порванную кроссовку? Вопросов очень много, однако они не останавливают инженеров.

Недавно на форуме «Армия-2021» российские разработчики рапортовали о новой версии продвинутого комплекса скрытого обнаружения опасных объектов и запрещенных веществ в потоке людей. Она, по словам представителя организации, работавшей над системой, научилась определять шесть базовых эмоций человека (вероятно, специалист ошибся, говоря о видах эмоций, а не самих эмоциях).

«Мы можем на основе данных комплекса досмотра и системы распознавания эмоций сделать заключение, опасен человек или не опасен», — заявил начальник научно-тематического центра со сложным названием «Т» АО «НПК „НИИДАР“» (НИИДАР) Никита Бобков. Исходя из этой цитаты, можно предположить, что система работает со 100-процентной точностью, а это невозможно. Но, вероятно, Бобков имел в виду общую картину, когда человек переносит скрытое оружие, запрещенные вещества и к тому же пышет гневом.

Благодаря описанию становится чуть понятнее: платформу намерены модернизировать для идентификации человека по ряду параметров (походка и другие внешние признаки), а также фиксации изменения его состояния — так называемого «подозрительного поведения». Российские разработчики уверяют, что «технология способна определить, искренне человек выражает эмоции или имитирует их». Как это будет работать на людях, не способных выражать эмоции либо страдающих различными расстройствами здоровья, не уточняется.

Идея автоматического распознавания эмоций и создания алгоритмов, позволяющих сделать это на лету и без участия человека, стала особенно популярной несколько лет назад — причиной тому стало именно развитие ИИ, нейронных сетей, «больших данных» и способов работы с ними. Когда-то это были стартапы и просто исследования, сегодня — индустрия, объем которой оценивали в $20 млрд с прогнозом роста до $36 млрд в 2023 году.

Определенные шаги в этом направлении были сделаны очень давно. В США, например, пытались систематизировать проявления эмоций и использовать их «в поле» без привязки к науке и военным в начале нулевых. За основу для Screening of Passengers by Observation Techniques (SPOT) взяли Систему кодирования лицевых движений (СКЛиД), разработанную психологом Полом Экманом в 1978 году. В рамках программы сотрудников аэропортов обучали выявлять потенциально опасных личностей (террористов) через камеры видеонаблюдения.

Если коротко, эффективность программы оказалась минимальной, здесь царствовал рандом. Как заявил Экман, проблема в неправильном применении предложенных им техник. Со стороны звучали заявления, что причина в устаревании подхода и считать эмоции лишь по выражению лица нельзя. Тем не менее именно алгоритмы Экмана легли в основу многих современных автоматизированных систем распознавания эмоций.

Они существуют и применяются во многих сферах: от служб безопасности аэропортов до отделов кадров, изучающих претендентов на вакансии. На сайте emojify.info вы можете оценить работу подобных алгоритмов.

Одна из целей проекта — показать, насколько несовершенны такие системы (в игре Fake Smile Game надурить ИИ без подготовки сможет почти каждый). Также проект доказывает необходимость понимания контекста для правильного определения эмоционального состояния и действий человека. Ведь автоматизированные системы и даже обычный человек, не зная обстоятельств, могут легко ошибиться.

Китай во многом старается быть первым, и технология распознавания эмоций не исключение. Чего только стоит система социального рейтинга, которая в автоматическом режиме делит людей на хороших и плохих.

В стране успешно работает обширная сеть распознавания лиц, позволяя найти практически любого гражданина за считанные секунды. Такая система в тандеме с алгоритмами различения эмоций, считают некоторые эксперты, может с успехом применяться для «контроля настроений»: человек, зная, что за ним постоянно следят, будет действовать в соответствии с этим знанием. Тема не раз поднималась в фантастических произведениях (роман «451 градус по Фаренгейту», фильм «Эквилибриум»).

Пока за переход в неположенном месте фото пешехода может просто оказаться на всеобщем обозрении на уличном экране (это реальный пример из жизни Китая), нарушивший какое-то правило моментально получит на мобильник уведомление о штрафе, а отмотавший слишком много туалетной бумаги в общественном туалете — счет. А с системой распознавания эмоций нужно будет не только подчиняться общим правилам, но и излучать вовне исключительно позитив (еще в 2012 году правительство Китая рекомендовало гражданам быть максимально позитивными, патриотичными и этичными — как минимум в интернете).

Одним из игроков на китайском рынке систем распознавания эмоций является компания Taigusys. Ее решения установлены примерно в 300 тюрьмах, следственных изоляторах и подобных учреждениях, в сети насчитывается 60 тыс. видеокамер.

По словам управляющего Taigusys, платформа может применяться для предсказания агрессивного поведения в тюрьмах, указывать на потенциально опасных личностей в полицейских участках, проблемных детей в школах и страдающих приступами деменции людей в клиниках. Представитель компании подтвердил гипотезу о том, что сам факт знания о наблюдении влияет на поведение: заключенные, например, стали более покладистыми.

Некоторую критику вызвала лишь установка считывающих эмоции камер в школах, где их используют для мониторинга детей и педсостава. Западные СМИ указывают, что недовольств было на удивление мало, упуская нюанс невозможности критиковать решения властей.

В качестве примера вероятной эффективности Taigusys ее управляющий приводит инцидент с участием мужчины, напавшего на воспитанников детского сада в провинции Гуанси и ранившего несколько десятков человек. Он заявил, что «технологически» ситуации можно было избежать. Однако проверить его слова невозможно.

На вопрос о возможности неправомерного использования технологии представитель компании заявил, что не боится этого: «Ведь все ПО находится в распоряжении полиции».

Многие специалисты сходятся в том, что технология на ее текущем этапе развития (с далекой от идеала точностью) имеет право на существование лишь в ограниченном списке сфер. Простейший пример: неудачная шутка может испортить отношения. Что уж говорить об ошибочном распознавании эмоций. Существующие системы имеют разную эффективность при обработке данных людей с разным цветом кожи, разного возраста и пола, проявление эмоций может варьироваться даже в зависимости от уровня образования (!), а есть еще множество демографических и иных факторов.

Интеграция этой технологии в системы общественной безопасности, считают специалисты, не принесет плодов и является лишь обоснованием для развертывания все большего количества систем наблюдения и контроля. А когда технология станет достаточно развитой, ее нужно будет жестко контролировать и не использовать повсеместно.

Где автоматизированное распознавание эмоций оправданно? В маркетинге для оценки реакции на рекламу или товар (такие продукты уже продвигают Amazon, Microsoft и IBM, а также ряд менее крупных); наблюдении за водителями и их поведением на дороге; при тестировании игр; при оценке степени удовлетворения пациентов и в различных фокус-группах.

Да, практически любая технология может нести положительные изменения, вопрос в том, кто и зачем ее применяет и насколько она развита. В противном случае нас ждет внешне прекрасная антиутопия.

Источники: «Синьхуа», ТАСС, TechMonitor, The Guardian (1, 2), CNET, VentureBeat, Financial Times.

Читайте также:

- Уверены, что начальник не читает ваши чаты? Вот как компании следят за сотрудниками

- Любовный треугольник. Укус помог раскрыть убийство спустя 23 года

Для учебы, работы и отдыха. Более 5 тыс. моделей ноутбуков в Каталоге с детальными фильтрами

Наш канал в Telegram. Присоединяйтесь!

Есть о чем рассказать? Пишите в наш телеграм-бот. Это анонимно и быстро

Перепечатка текста и фотографий Onlíner без разрешения редакции запрещена. ng@onliner.by