Как искусственный интеллект играет в прятки. Об экспериментах OpenAI

Сперва жертвы беспорядочно бились о стены. Потом панически убегали от врагов. Затем научились блокировать проходы с помощью коробок. А когда враги начали использовать пандус, чтобы перепрыгивать через стены, жертвы смекнули, что этот пандус можно спрятать и почти гарантированно победить. Вот только после этого ИИ научился мухлевать, не нарушая правила, но используя недочеты в их логике.

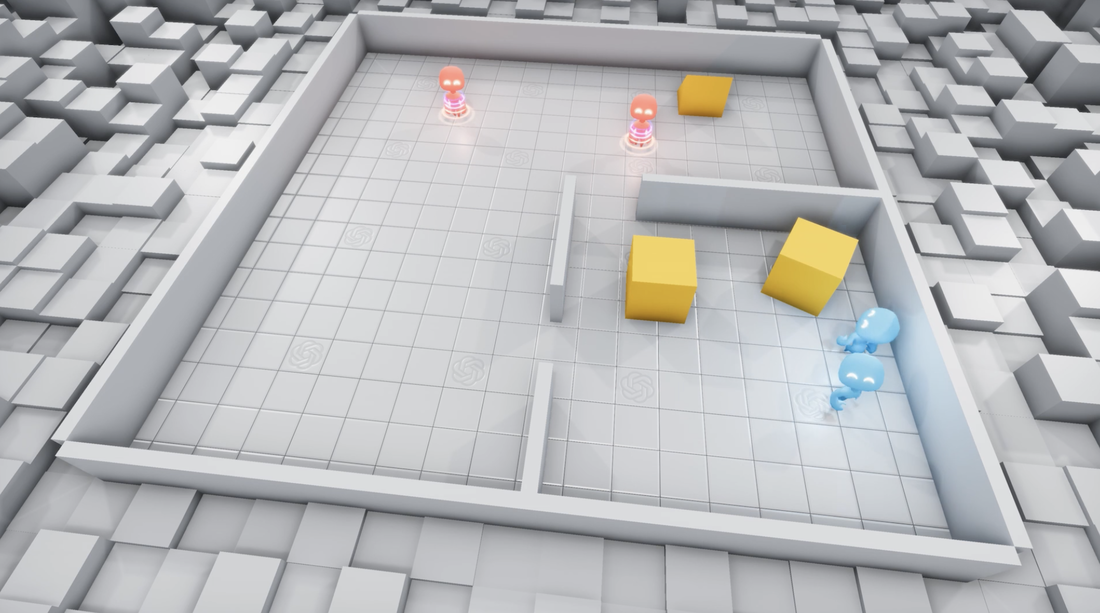

Да, все верно. Речь про искусственный интеллект, который играет в прятки: красные ищут, синие прячутся. И так миллионы, десятки миллионов и сотни миллионов попыток, в ходе которых ИИ ошибается, обучается и находит неожиданные решения, способные удивить даже самих разработчиков из OpenAI.

Сегодня поговорим именно про этих передовиков в сфере разработки искусственного интеллекта — компанию OpenAI. Она создавалась как некоммерческая организация, которая должна была работать на благо общества в сфере создания и обуздания искусственного интеллекта. По крайней мере такие смыслы закладывали в нее Илон Маск и другие сооснователи в 2015 году.

Спустя пару лет Маск ушел из правления OpenAI, а компания стала зарабатывать на своих изобретениях и оценивается уже не так однозначно положительно, как это было на старте. Об этом позже, а пока вернемся к игре в прятки с искусственным интеллектом.

Прятки с ИИ

Наверное, это один из самых впечатляющих экспериментов OpenAI. По крайней мере он красочный, наглядный и простой для понимания. Есть две команды: красных и синих человечков. Одни ищут, другие прячутся. На игровой арене есть стены, по ней разбросаны разные предметы. Искусственный интеллект отправляют на них абсолютно девственным. Он не знает, как использовать свои способности, как лучше укрываться или прятаться. Однако благодаря миллионам повторений и командному вознаграждению участники игры открывают для себя все более сложные инструменты, различные стратегии и контрстратегии, адаптация к которым приводит к чрезвычайно сложному и интеллектуальному поведению на арене.

Есть комната, две двери, пара ящиков и пандус. Первые два с половиной миллиона игр проходят в беспорядочной беготне по арене. К восьмому миллиону повторений команда синих обнаруживает способность двигать ящики и перекрывать ими проходы в комнату, пока красные в состоянии стазиса дают им фору. Еще около семи миллионов игр уходит на то, чтобы красные подобрали ключик к взлому комнаты. Они научились двигать пандус, чтобы с его помощью перепрыгивать через стену.

Следующие 30 млн попыток понадобились команде синих, чтобы научиться на старте уводить пандус в свою безопасную комнату. При этом обратите внимание, насколько скоординированными и отточенными оказываются действия команды синих: пандус бросают так, чтобы он не перекрывал траекторию коробкам, которыми будут закрывать двери. А один из синих даже пододвигает коробку для напарника, чтобы тому не пришлось тратить драгоценное время на беготню к ней.

Самое удивительное, что в ходе этих бесчисленных миллионов попыток искусственный интеллект обнаруживает уязвимости в логике своего мира, незадокументированные самими разработчиками механики, которые позволяют тем, кто прячется, или тем, кто ищет, добиваться победы. Синие в какой-то момент обнаружили, что контакт пандуса со стеной под определенным углом приводит к его вылету за пределы арены. Похожую уязвимость используют красные, когда обнаруживают, что удар пандусом о стену заставляет их взлететь и поймать взглядом синих. Это победная стратегия. Ее повторение с победным результатом приводит к закреплению.

Спортзал для ИИ

Такой способ машинного обучения называют обучением с подкреплением. Это метод проб и ошибок, когда агент взаимодействует со средой и получает сигналы подкрепления. В случае с прятками агент — это синий или красный участник игры, а подкрепление — это победные очки в конце партии. ИИ запоминает эффективные действия, которые принесли ему победу, и начинает использовать их.

Правда, искусственному интеллекту нужны десятки миллионов попыток, чтобы начать демонстрировать эффективные результаты. Конечно, многое зависит от сложности окружения и задачи, которую перед ним ставят.

Например, есть простенькая задача по посадке лунного модуля между двумя флажками на игровом поле. У модуля основной двигатель и два боковых. Используя эти двигатели, ИИ должен аккуратно приземлиться между флажками, за что получит максимальное количество очков. Крушение отнимает сотню очков, работа каждого двигателя отнимает по 0,3 очка за каждый игровой кадр.

Спустя 15 минут лунный модуль уже приземляется на обе ноги. Спустя час приземление становится более плавным, экономным и точным.

Поиграться с тренировкой искусственного интеллекта можно и самому. OpenAI создала набор инструментов Gym для разработки и сравнения алгоритмов обучения с подкреплением. Набор позволяет обучать агентов всему — от посадки того самого лунного модуля до игры в «Космических захватчиков». Конечно, для этого нужны определенные знания в написании алгоритмов и языке программирования Python. Но кто знает, может, именно этот спортзал искусственного интеллекта и сподвигнет вас к освоению таких навыков.

«Имитатор-3»

Все упомянутое выше — это скорее игрушки, забавный аттракцион, который демонстрирует возможности машинного обучения в ярких красках. Основной продукт OpenAI — это GPT3, алгоритм обработки естественного языка третьего поколения. Он умеет создавать тексты, практически неотличимые от того, что пишет человек.

Эту систему еще несколько лет назад считали в OpenAI «слишком опасной» и отказывались обнародовать (хотя в изначальном уставе компании-разработчика декларировалась открытость). Разработчики переживали, что их алгоритм может использоваться людьми с нечистыми помыслами. В качестве наиболее безвредного примера называли генерацию фейковых отзывов в интернет-магазинах.

Тем не менее это не помешало OpenAI лицензировать GPT3 эксклюзивно для Microsoft. IT-гигант получил доступ к исходному коду технологии, тогда как все остальные довольствуются работой с GPT3 через API (программную прокладку) и только после одобрения со стороны разработчиков.

OpenAI мотивировала это тем, что для создания лучших в своей сфере продуктов компании нужно зарабатывать деньги и с их помощью финансировать разработку, чтобы не отставать от конкурентов. В качестве некоммерческой организации делать это было невозможно.

Например, в 2017 году OpenAI потратила на облачные вычисления почти $8 млн — четверть от всех своих расходов, тогда как другая известная ИИ-лаборатория — DeepMind, за которой стоит Google, — в том же году позволила себе расходы в размере $440 млн. Переход на коммерческие рельсы позволит привлекать инвестиции в погоне за созданием настоящего искусственного интеллекта. Все, что пока есть у человечества, — это так называемые слабые ИИ, которые способны решать ограниченный круг задач.

Тот самый GPT3 — это слабый ИИ. Название, возможно, выглядит уничижительно, но GPT3 умеет генерировать текст, который сложно отличить от написанного человеком. С ним можно пообщаться на какие-то рядовые темы, его проза и даже поэзия могут быть одновременно удивительными и устрашающими. Все-таки это пугающая демонстрация того, как программа движется по пути познания человеческой речи.

Сегодня GPT3 используют сотни различных компаний и стартапов. Microsoft, например, прикрутила алгоритм к платформе разработки простых бизнес-приложений. GPT3 переводит разговорный язык в программный код для выполнения на этой платформе.

Браузерная игра AI Dungeon 2 — это текстовая адвенчура, которая взяла GPT3 на вооружение с целью генерации контентного наполнения для игры и подарила обширные, наполненные персонажами и мотивациями миры в различных популярных литературных сеттингах.

Стартап OthersideAI использует GPT3 для конвертации коротких ответов и заметок в хорошо составленные персонализированные электронные письма, которые выходят за рамки банальной функции автоответа.

У GPT3 хватает недостатков. Так как она учится на основе огромного количества общедоступных текстов, ее ответы могут быть некорректными или даже оскорбительными. В ней уже заметили некорректное поведение со словами «черный» и «еврей», а тесты медицинского чат-бота на основе GPT3 привели к тому, что бот посоветовал условному пациенту с суицидальными мыслями покончить с собой.

Искусственный интеллект прошел большой путь, но все еще находится в его начале. До создания настоящего ИИ нам еще далеко. По крайней мере, на это можно надеяться.

Наш канал в Telegram. Присоединяйтесь!

Есть о чем рассказать? Пишите в наш телеграм-бот. Это анонимно и быстро

Перепечатка текста и фотографий Onliner без разрешения редакции запрещена. nak@onliner.by