Пять неожиданных навыков, которые привили компьютерам

Роботы и суперкомпьютеры могут быть ужасны. Если вы считаете иначе — вы либо ученый-кибернетик, либо сами робот. Думаете, что мы преувеличиваем и просто пытаемся заставить вас прочитать эту статью? Возможно, вы правы. Но если эти устройства так безопасны, поясните, почему ученые…

Привили компьютеру шизофрению

Исследователи из Университета Техаса наконец сделали это. Они смогли перенести ментальные заболевания в цифровые реалии, доведя суперкомпьютер до шизофрении.

Мы никогда не узнаем, действительно ли у ученых изначально стояла такая задача или это шутка практиканта. Впрочем, гадать уже поздно. Нейронная сеть (искусственный разум, который симулирует связи в мозгу человека) DISCERN существует.

Чтобы описать механизм шизофрении, исследователи используют теорию гиперобучения, которая постулирует следующее: шизофреники помнят слишком много информации. Они запоминают вещи, которые не так важны, и не могут ими правильно воспользоваться.

Изначально ученые рассказали компьютеру DISCERN много историй и дали время на установление закономерностей между словами и событиями. В памяти сохранили только релевантные детали, и поначалу все было хорошо. Следующим шагом было снижение планки релевантности: пошла более глубокая расшифровка памяти и компьютер обязали выдавать все детали — как релевантные, так и нет. В итоге получился компьютер с шизофренией. Он потерял все, чему учился, и уже не мог выдавать связные ответы.

При дальнейшем общении ученых с компьютером стали происходить интересные вещи. В определенный момент DISCERN взял на себя ответственность за теракт, буквально сообщив исследователям, что заложил бомбу. Так произошло потому, что он спутал рассказ третьей стороны про террористическую атаку с памятью от первого лица.

В другом случае компьютер стал говорить о себе в третьем лице — он ощутил деперсонализацию и больше не знал, кем или чем является.

На самом деле программа имитировала повышенное содержание дофамина. В итоге компьютерный мозг или терял способность забывать/игнорировать, или же не мог извлекать смысл из необъятной памяти.

Научили роботов врать

Ученые научили группу роботов некоторым стратегиям жульничества и обмана. Эти модели поведения были позаимствованы после наблюдений за поведением птиц и белочек (пожалуй, самые хитрые зверьки во всем царстве животных) и продемонстрированы профессором Рональдом Аркином из Технологического университета Джорджии. Первый робот должен был отправиться по указанному маршруту и найти себе место для укрытия. Следом за ним выезжал робот-настигатель.

Роботы следовали по пути с установленными препятствиями, которые по ходу игры сбивались. Один из роботов убегал, а второй двигался по следам сбитых препятствий, чтобы найти первого. Убегающий робот, однако, изучил систему и специально опрокидывал препятствия, чтобы создать ложный след. После чего он предпочитал прятаться подальше от созданного беспорядка. Используя такую простую тактику, дроид-беглец водил за нос дроида-сыщика 75% времени.

Опять же, данная стратегия не была запрограммирована в роботе изначально. Это то, к чему он пришел совершенно самостоятельно, после некоторых проб и ошибок. Хорошо, что это был лишь скромный опыт в университете, а не развлечение военных с Десептиконами.

«Так ведь они уже таким занимаются!..» — возразите вы. Действительно, этот безобидный эксперимент финансируется управлением военно-морских исследований. В армии планируют использовать роботов, чтобы защищать боеприпасы и другие предметы первой необходимости.

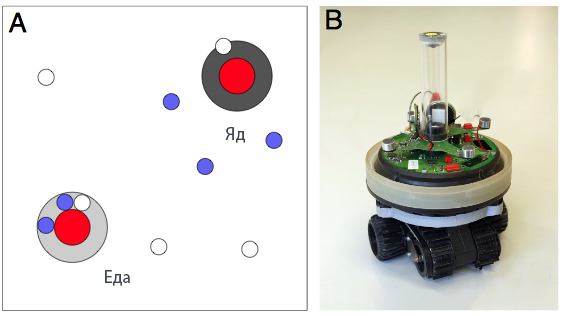

Научили роботов беспощадности

Ученые из лаборатории интеллектуальных систем взяли группу роботов, источники «киберпищи» и источник «киберяда» и поместили их всех вместе в одной комнате. Затея «отравить» робота уже сама по себе выглядит странно, но мы прокомментируем усилия ученых: к несчастью, машины не умерли, а познали путь к жестокости.

Роботы получали очки за нахождение вблизи источника «еды» и теряли их по мере приближения к «яду». Они получили маленькие синие мигалки, которые срабатывали случайно (также роботы могли управлять мигалкой, если хотели, но об этом позднее), и камеры для приема сигнала.

После начала эксперимента машинам не потребовалось много времени, чтобы понять — синие вспышки находятся там, где собираются роботы-конкуренты, то есть возле источников «еды». Излучая свет случайным образом, роботы делали себе медвежью услугу — они показывали другим роботам, где находится «еда».

Именно поэтому после нескольких раундов эксперимента большинство машин почти полностью перестали мигать своими огнями. Таким образом, первое, от чего отказались роботы, — помогать друг другу. Это может и хорошо для человечества, но самое интересное началось позже: некоторые роботы отходили от источников «еды» и подло мигали интенсивнее, чтобы увести от «кормушки» других.

Научили суперкомпьютеры воображать

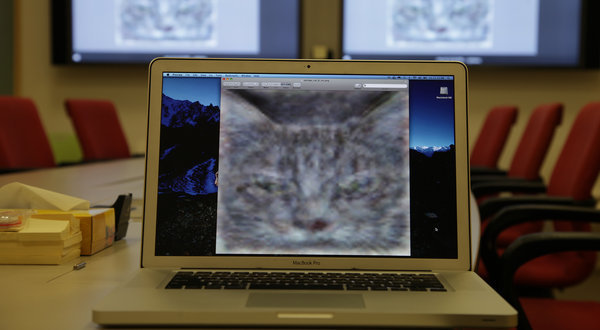

Среди многих проектов компании Google, которые однажды приведут к закату цивилизации, отдельно стоит отметить обучающуюся нейронную сеть. Про ее друга, сеть-шизофреника, вы могли узнать в первом пункте этой статьи. Созданная нейронная сеть не шизофреник, однако ужасает степенью своей разумности. Суперкомпьютер Google свободно подключили к интернету и позволили изучать все, что кремниевой душе угодно. В инструкциях по серфингу не было никаких ограничений и меток. Наделенный способностью изучать квантовую физику и все аспекты истории человечества, суперкомпьютер пошел… смотреть фотографии котиков.

Неужели люди из плоти и крови и подрастающие цифровые монстры в процессе обучения используют интернет схожим образом? Как оказалось, компьютер быстро разработал свою собственную концепцию того, как выглядят коты. На ее базе он смог представить полностью нового кота. Компьютер разработал свой собственный аналог визуального кортекса в мозгу человека.

Это достаточно симпатичный кот. Отличная работа, суперкомпьютер

А вот с людьми пока получается не так хорошо

Научили компьютеры предсказывать будущее

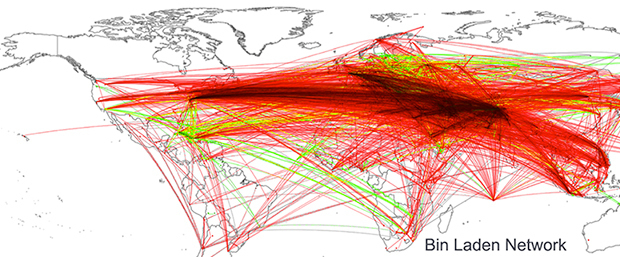

Nautilus — еще один обучающийся суперкомпьютер. В него внесли более миллиона новостей, включая архив газет с 1945 года, и запрограммировали анализировать только две вещи: настроения и указанные в тексте места расположения. Используя такую огромную базу информации из прошлых событий, компьютер мог делать ретроактивные догадки о том, что произойдет в будущем. И его предположения оказались неожиданно точными. Например, он установил местонахождение Осамы бин Ладена.

Конечно, суперкомпьютер не въезжал к террористу домой на гусеницах и с фотоаппаратом в руке. Он просто располагал данными, на основе которых установил примерное местоположение человека.

У США ушло 11 лет, две войны, два президента и миллиарды долларов на то, чтобы установить местонахождение террориста номер один. И все это время предполагалось, что он находится в Афганистане. Компьютер Nautilus затратил значительно меньше времени, и все, чем он занимался в процессе, — изучал сводки новостей, ссылающихся на бин Ладена и соответствующие места. Результатом стал квадрат площадью 200 км2 на севере Пакистана. Эта зона включала город Абботабад и странный дом, где террориста фактически и нашли.

Если в ретроспективе это кажется очевидным и отслеживание самого неуловимого человека в мире вас не удивляет, то Nautilus может пойти дальше. Например, он также предсказал события Арабской весны, просто отслеживая настроения в прессе, использование положительных и отрицательных терминов.

Но пока это все ретроактивно: мы даем Nautilus’у информацию о случившемся и смотрим, может ли он предсказать события, о которых нам уже известно. Однако ученые изучают возможности предсказания будущего по событиям реального времени.

Например, полицейские в Балтиморе уже используют программное обеспечение, которое предсказывает убийство, как в фильме «Особое мнение». На основе различных факторов (природа преступлений, частота и т. д.) ПО постоянно меняет алгоритм, чтобы определить вероятность убийства.

В общем, компьютеры, предсказывающие будущее, приводят в замешательство. К тому же все они продолжают предсказывать вымирание человечества после того, как сами обзаведутся ногами.

Перепечатка текста и фотографий Onliner.by запрещена без разрешения редакции. db@onliner.by